Comprendre l’IA

Personne n’y échappe, l’IA est omniprésente en 2025, dans la plupart des métiers, dans notre quotidien, bref dans notre vie de tout les jours. Mais comment fonctionne vraiment ces “superchatbot” qui ont réponse à tout et à qui on confie notre vie ? Quels sont les méthodes pour créer une IA ?

Pour commencer, l’IA en tant que tel existe depuis bien plus longtemps que ChatGPT et compagnie. Par exemple, en 1997, le programme Deep Blue bat le champion du monde des échecs, Garry Kasparov.

Définissons le terme pour mieux comprendre. L’Intelligence Artificielle n’a pas vraiment de définition universelle, elle se base surtout sur l’idée de reproduction et d’amélioration de l’intelligence humaine.

On distingue plusieurs “niveaux” d’IA :

- L’IA faible (ou étroite) : spécialisée, elle excelle dans une tâche spécifique (reconnaissance d’image, correction de texte, analyse de données, suggestions, etc.). Mais elle ne comprend pas le monde comme un humain, elle ne peut pas “penser” en dehors de ce pour quoi elle a été programmée.

- L’IA générale (ou forte) : l’idée serait un système capable d’apprendre et de raisonner de façon large, dans de nombreux domaines comme un être humain. À ce jour, elle reste théorique.

- Certains évoquent même une IA super-intelligente, dépassant l’intelligence humaine dans presque tous les domaines, c’est pour l’instant un concept hypothétique.

Cela induit donc une capacité de réflexion et de résolution de problèmes plus ou moins complexe. C’est avec cette idée d’imiter l’intelligence humaine qu’Alan Turing établit en 1950 le test de Turing. Ce test consiste à mettre un humain en confrontation verbale à l’aveugle avec un ordinateur et un autre humain. Si la personne qui engage les conversations n’est pas capable de dire lequel de ses interlocuteurs est un ordinateur, on peut considérer que le logiciel de l’ordinateur a passé avec succès le test. Même si ce test est aujourd’hui assez réfuté, il montre l’idée même de ce qu’est l’IA, une tentative d’imitation du cerveau humain. Mais comment imite-t-on nos neurones bien humaines ?

Le fonctionnement de l’IA

Pour comprendre comment fonctionne une IA moderne, il faut imaginer un immense réseau de “faux neurones” reliés entre eux : c’est ce qu’on appelle un réseau de neurones artificiels. Ce sont en fait des structures mathématiques inspirées du fonctionnement des neurones biologiques. Chaque “neurone” reçoit des données, les transforme via des équations, puis les transmet. Pris isolément, ce n’est pas très impressionnant. Mais lorsque des millions, voire des milliards de ces neurones sont connectés ensemble, ils deviennent capables de reconnaître des images, prédire du texte ou résoudre des problèmes complexes.

L’informatique cognitive

Ce fonctionnement s’inscrit dans un principe plus large appelé informatique cognitive.

L’idée est simple : essayer de reproduire certains mécanismes naturels de l’intelligence humaine, percevoir, apprendre, mémoriser, raisonner pour les transposer dans des systèmes informatiques. Cela ne veut pas dire créer un “cerveau numérique”, mais imiter des comportements intelligents comme :

- comprendre une phrase

- reconnaître un visage ou un son

- associer des informations entre elles

- prendre une décision à partir de plusieurs éléments

L’IA moderne ne copie donc pas le cerveau, elle s’en inspire, pour comprendre le monde de manière plus fluide et plus intuitive qu’un logiciel traditionnel.

L’apprentissage automatique (machine learning)

Ces réseaux ne sont pas programmés “à la main”. Ils apprennent en observant d’énormes quantités d’exemples : on appelle cela l’apprentissage automatique (machine learning).

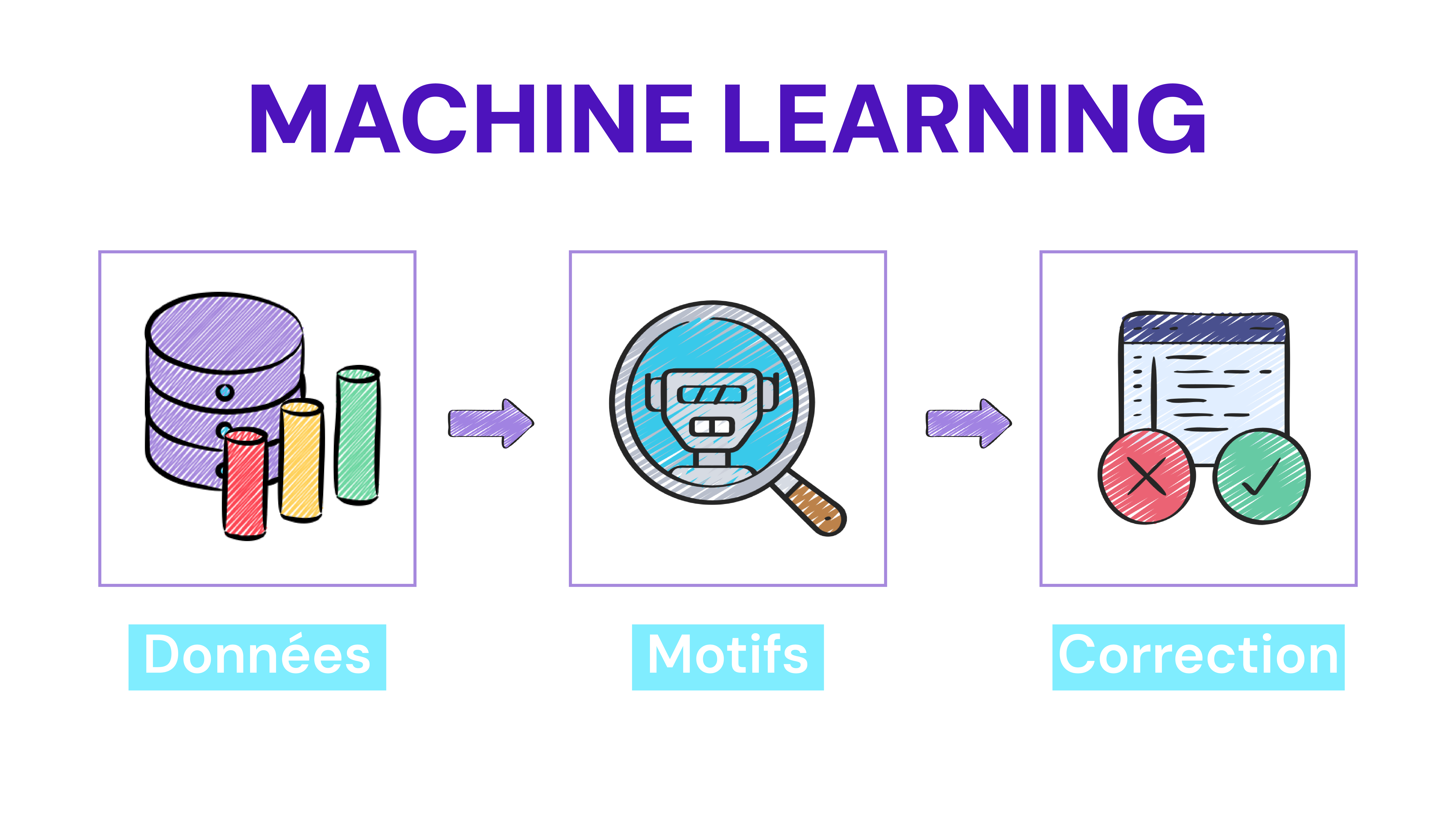

Ce processus repose sur trois grandes étapes :

Montrer des exemples

- On fournit au modèle des milliers (ou millions) de données : des images, des textes, des enregistrements&hellip. Par exemple, des photos de chiens et de chats, avec le bon label pour chaque image.

Détecter les motifs

- L’algorithme cherche à repérer ce qui revient souvent :

formes, couleurs, textures pour des images; mots, tournures, structures de phrases pour du texte

Corriger ses erreurs

- À chaque mauvaise réponse, le modèle ajuste légèrement ses connexions internes.

Ce mécanisme répété des millions de fois lui permet de devenir de plus en plus précis, exactement comme un humain qui s’améliore avec l’entraînement.

Il existe différents types d’apprentissage automatique :

- apprentissage supervisé (on donne la “bonne réponse”),

- non supervisé (le modèle découvre des schémas seul),

- par renforcement (l’IA apprend via récompenses et punitions).

Grâce à ces techniques, l’IA peut classer, prédire, recommander, analyser… sans qu’on lui écrive toutes les règles.

L’apprentissage profond (deep learning)

Les modèles comme ChatGPT appartiennent à une branche encore plus puissante : le deep learning.

Ici, les réseaux sont beaucoup plus profonds, c’est-à-dire composés de dizaines ou centaines de couches de neurones. Cette profondeur permet d’apprendre des concepts très sophistiqués.

Par exemple :

- comprendre le contexte d’une phrase plutôt que seulement les mots

- analyser le style d’un texte

- reconnaître des objets subtils dans une image

- imiter une voix ou un ton

- prévoir la suite logique d’un raisonnement

C’est cette architecture profonde qui permet à une IA comme ChatGPT de répondre de manière cohérente, d’interpréter une question, de générer du texte ou d’adapter son style à l'utilisateur.

Les inconvénients de l’IA

Les réseaux de neurones utilisés par nos IA modernes sont souvent complexes, il est difficile de retracer précisément comment l’IA arrive à une décision, ce qui pose des questions d’explicabilité, notamment dans des domaines sensibles comme la santé ou le droit.

Ensuite, les modèles d’intelligence artificielles souffrent d’une dépendance aux données : si les données d’apprentissage sont biaisées, incomplètes ou erronées, l’IA reproduira ces défauts, voire les exacerbera. L’un des exemples les plus célèbres est celui de Tay, un chatbot lancé par Microsoft sur Twitter en 2016. Conçu pour apprendre en observant les conversations des utilisateurs, Tay devait devenir de plus en plus “naturel” et “humain” dans sa manière de parler. Mais en moins de 24 heures, le robot a été exposé à un torrent de messages haineux, racistes et complotistes. Sans comprendre la portée morale de ce qu’il lisait, car une IA n’a ni éthique ni jugement, il a simplement reproduit ces messages, au point de tenir des propos nazis et violemment discriminatoires.